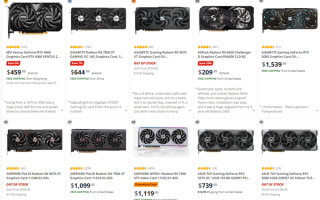

- 第一页 前言:本地部署大模型 不依靠显卡其实也可以

- 第二页 Ollama:高效轻量化 简洁到硬核的程度

- 第三页 通过浏览器插件使用图形化界面:Page Assist插件简单方便

- 第四页 ChatBox AI客户端:让AI大模型更聪明

- 第五页 LM Studio部署工具:更方便易用的工具 但效率不如Ollama

- 第六页 本地AI应用1:配合沉浸式翻译插件 使用本地AI大模型翻译网页

- 第七页 本地AI应用2:建立本地知识库 通过AI大模型快速处理海量数据

- 第八页 总结:轻薄本没有显卡一样能部署本地AI大模型 而且还很好用

标签: Intel

版权声明:除非特别标注,否则均为本站原创文章,转载时请以链接形式注明文章出处。